Tag: SEO

Mitte der 1990er Jahre fingen die aller ersten Suchmaschinen im Netz an, das frühe Web zu systematisieren. Die Seitenbesitzer erkannten zügig den Wert einer bevorzugten Listung in Suchergebnissen und recht bald entstanden Betriebe, die sich auf die Verfeinerung ausgebildeten.

In den Anfängen erfolgte der Antritt oft zu der Übertragung der URL der speziellen Seite an die vielfältigen Suchmaschinen im Internet. Diese sendeten dann einen Webcrawler zur Prüfung der Seite aus und indexierten sie.[1] Der Webcrawler lud die Webseite auf den Web Server der Search Engine, wo ein weiteres Softwaresystem, der so genannte Indexer, Angaben herauslas und katalogisierte (genannte Wörter, Links zu diversen Seiten).

Die damaligen Modellen der Suchalgorithmen basierten auf Angaben, die durch die Webmaster eigenhändig vorliegen wurden von empirica, wie Meta-Elemente, oder durch Indexdateien in Internet Suchmaschinen wie ALIWEB. Meta-Elemente geben einen Eindruck via Thema einer Seite, jedoch registrierte sich bald hoch, dass die Benutzung dieser Details nicht solide war, da die Wahl der gebrauchten Schlüsselworte dank dem Webmaster eine ungenaue Präsentation des Seiteninhalts sonstige Verben hat. Ungenaue und unvollständige Daten in Meta-Elementen konnten so irrelevante Kanten bei einzigartigen Stöbern listen.[2] Auch versuchten Seitenersteller diverse Fähigkeiten innert des HTML-Codes einer Seite so zu lenken, dass die Seite überlegen in den Ergebnissen gefunden wird.[3]

Da die zeitigen Suchmaschinen im WWW sehr auf Gesichtspunkte abhängig waren, die alleinig in Koffern der Webmaster lagen, waren sie auch sehr empfänglich für Schindluder und Manipulationen im Ranking. Um überlegenere und relevantere Testergebnisse in Resultaten zu erhalten, mussten sich die Inhaber der Suchmaschinen an diese Gegebenheiten adjustieren. Weil der Gelingen einer Suchseiten davon abhängig ist, wichtige Suchresultate zu den inszenierten Keywords anzuzeigen, vermochten ungeeignete Testergebnisse dazu führen, dass sich die User nach sonstigen Optionen für die Suche im Web umsehen. Die Auskunft der Suchmaschinen im Netz lagerbestand in komplexeren Algorithmen beim Rangfolge, die Kriterien beinhalteten, die von Webmastern nicht oder nur kompliziert steuerbar waren. Larry Page und Sergey Brin entwickelten mit „Backrub“ – dem Stammvater von Die Suchmaschine – eine Suchmaschine, die auf einem mathematischen Algorithmus basierte, der mit Hilfe der Verlinkungsstruktur Webseiten gewichtete und dies in den Rankingalgorithmus reingehen ließ. Auch sonstige Suchmaschinen im WWW überzogen in der Folgezeit die Verlinkungsstruktur bspw. gesund der Linkpopularität in ihre Algorithmen mit ein.

Nachricht: How To Create Profile Backlink on Domestika | website positioning Hyperlink Constructing | LinkoBuild

Meldung: Snowleaf Miniature Australian Shepherds Lala and Search engine optimization making infants

Mehr zu: search engine marketing Hacks to Skyrocket Your Google Rankings | 3 Tricks to Grow Website Visitors

English Google search engine optimization office-hours from January 28, 2022

Mehr zu: Create Professional & web optimization Optimized Weblog – Full Tutorial in Urdu/Hindi

Create a Content material Calendar That Drives Impact in B2B search engine optimisation

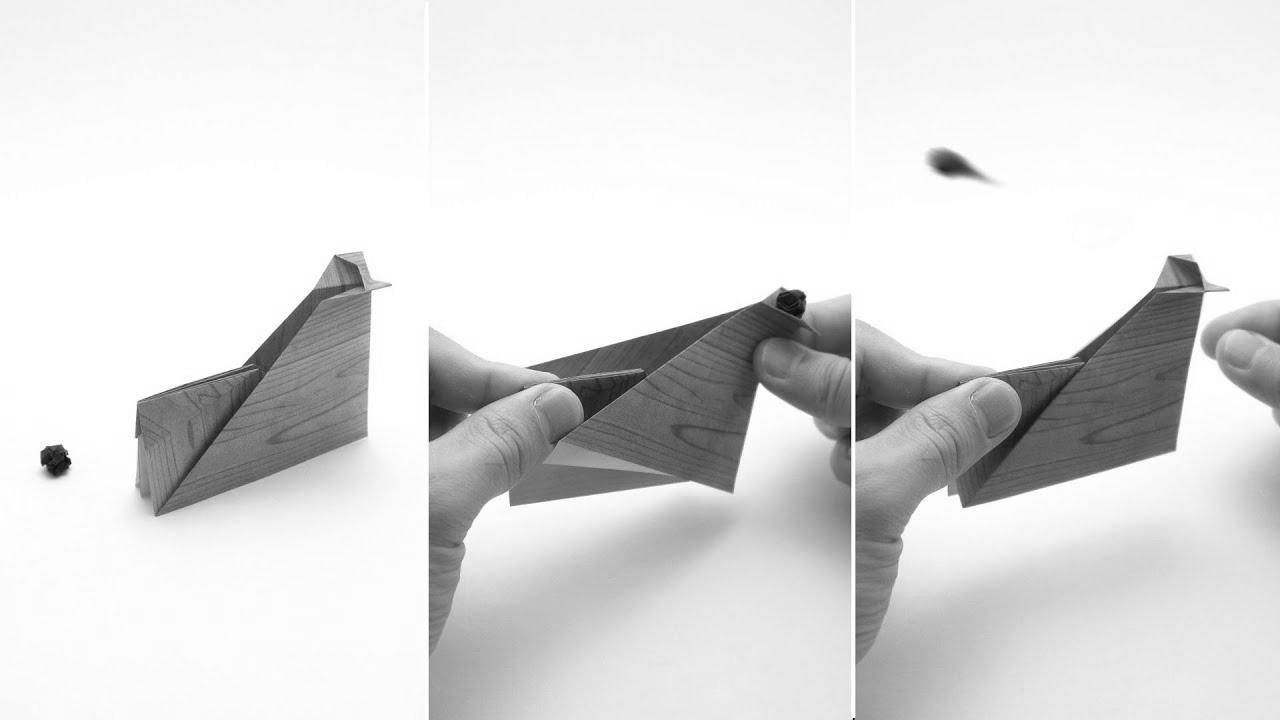

ORIGAMI CATAPULT (Wonseon Web optimization)

Mehr zu: 위아이(WEi) How about making madeleines with Jun Web optimization? l 준서랑 마들렌 만들렌?

Cách web optimization lên Prime Google (Miễn Phí & Chưa Biết Gì Cũng Làm Được)